Pressemelding —

Ny opplæring skal styrke beskyttelsen mot AI-manipulasjon

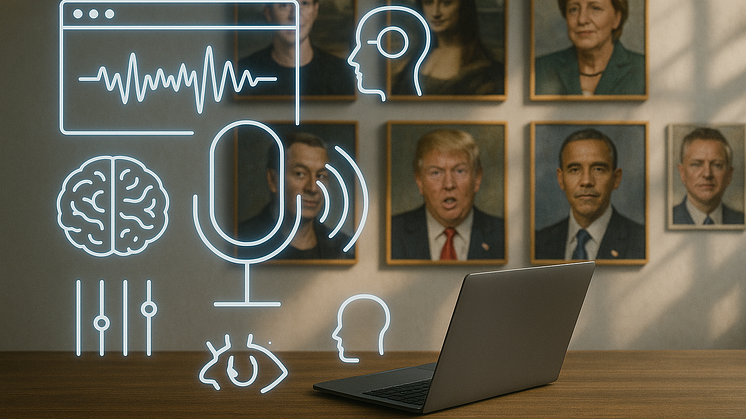

Cyberkriminelle har lenge brukt metoden phishing for svindel. Nå tar de i bruk AI for å skape mer troverdige svindler, kartlegge og studere sine ofre, samt forsterke metodene sine med deepfakes – som AI-genererte videoer og stemmesamtaler. Et nytt kurs fra Junglemap og Walma AI skal hjelpe virksomheter og ansatte til å bli mer bevisste og bedre rustet til å beskytte seg mot såkalt AI-manipulasjon.

Uavhengig av om vi selv bruker AI eller ikke, møter vi daglig ulike typer AI-tjenester og AI-generert innhold – ofte uten at vi engang vet om det. Som oftest i positive sammenhenger, men det kan være en risiko når AI havner i hendene på cyberkriminelle.

– Mange rapporter peker på at AI brukes stadig oftere i svindler og cyberangrep, sier Niklas Rosén, Director of Content i Junglemap og ansvarlig for det nye kurset. AIs raske utvikling gjør svindler og digitale trusler både vanskeligere å oppdage og beskytte seg mot. Vår sårbarhet øker i takt med at det blir stadig vanskeligere å skille mellom hva som er ekte og hva som er skapt av AI.

Fra før har Junglemap og Walma AI utviklet et introduksjonskurs i sikker bruk av generative AI-tjenester som ChatGPT og Copilot. Denne opplæringen har som mål å gi medarbeidere en økt forståelse for hvordan de kan bruke generativ AI på en ansvarlig, trygg og etisk måte. Det nye kurset fokuserer på situasjoner der vi møter AI uten å selv ha valgt det, og tar blant annet opp AI-forsterket phishing, deepfakes, fremtidens AI-systemer og AI-drevne cybertrusler gjennom eksempler og scenarier.

For å møte den raske utviklingen og de nye digitale truslene følger kurset NanoLearning-metoden, der deltakerne får korte 2–3-minutters leksjoner fordelt over hele året.

– Hensikten med kurset er å gjøre deltakerne mer bevisste og ”alltid ha AI i tankene”. Å få hele organisasjonen til å stoppe opp, tenke seg om, stille spørsmål og handle. Når noe føles litt merkelig, litt for bra eller skremmende – da kan det være snakk om AI-manipulasjon, sier William Friman, COO og medgründer av Walma AI. På samme måte som med informasjonssikkerhet generelt, må vi kontinuerlig bli påminnet om risikoene med AI-manipulasjon for å bygge en sterk digital motstandskraft.

Related links

Emner

Kategorier

Vår unike NanoLearningmetode skaper varig atferdsendring, reduserer risiko og gir målbar effekt.